在多次卷积操作中,如果不使用填充,每次卷积都会导致输出尺寸减小,最终可能使得图像的边缘信息丢失得很快。通过适当的填充,可以减缓尺寸的减小,避免信息丢失过快。是卷积神经网络(CNN)中的一个概念,它是指在...

”padding 卷积“ 的搜索结果

在跑一份代码时,效果一直提升不上去,偶然将3 * 3的卷积核换成了4 * 4的卷积核,效果奇佳,于是搜索了一下...“Convolution with even-sized kernels and symmetric padding” 这篇论文,解释了偶数卷积核对网络的影

如果没有 padding,每次卷积核移动计算后,都会导致卷积的输出尺寸变小,最终可能使得输入图像的边缘信息丢失,而填充了 padding 则有助于保留图像的边缘信息,防止信息在卷积过程中逐渐减小甚至丢失。Padding 指的...

文章目录(一) 卷积神经网络之padding操作(1) 卷积的缺点1.1 第一个缺点:图象缩小(输出缩小)1.2 第二个缺点:图像边缘信息发挥的作用小(2) Padding2.1 padding的取值2.1.1 **Valid**卷积2.1.1 **Same**卷积(3) ...

卷积操作图解.xlsx

标签: 神经网络 卷积

使用excel展示卷积的过程,静态的,可以作为简单理解卷积的参考。 里面有卷积的基本操作、加入padding层、池化层的操作等。

conv2d是常用的实现卷积的,Tensorflow调用Conv的api时,常用代码如下: 查看:https://tensorflow.google.cn/api_docs/python/tf/nn/conv2d tf.nn.conv2d( input, filter, strides, padding, use_cudnn_on...

关于神经网络中的padding

tensorflow官网定义的padding如下: padding = “SAME”输入和输出大小关系如下: 输出大小等于输入大小除以步长向上取整,s是步长大小; padding = “VALID”输入和输出大小关系如下: 输出大小等于输入大小减去...

padding的模式分为SAME和VALID两种方式。下面简单介绍一下两种方式输出shape的计算方法。 tensorflow VALID 计算公式: 输出的大小直接用输入的大小减去卷积核大小,加1,然后除以步长,最后对结果向上取整。 假如...

关于Tensorflow中卷积的padding其实在之前的课程中我有讲过,不过本节课会在详细讲解下,并和Pytorch中卷积的padding进行简单的对比。关于Pytorch中卷积的padding可以参考我之前写的一片文章。 在Tensorflow中卷积的...

神经网络常识

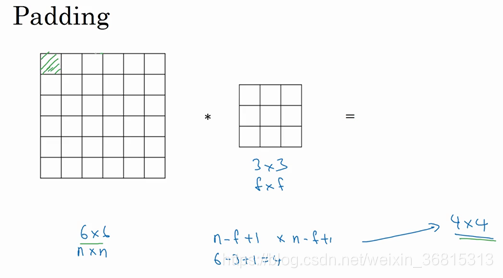

简介 卷积之后的尺寸大小计算公式为: 输入图片大小 W×W Filter大小 ...

手撕卷积神经网络历险记 三、padding操作图解 由于之前做了公众号版本,所以直接附上链接,可以直接点开查看 欢迎关注公众号一起交流! 基于上一篇,卷积前向传播c++实现 我们开始讲解padding,链接如下...

Yolov-1-TX2上用YOLOv3训练自己数据集的流程(VOC2007-TX2-GPU) Yolov--2--一文全面了解深度学习性能优化加速引擎---TensorRT Yolov--3--TensorRT中yolov3性能优化加速(基于caffe) yolov-5-目标检测:YOLOv2算法...

padding后特征图大小不变

标签: 深度学习

要想卷积(池化)后,大小不变就要使得padding取得合适的值。 第一种方法; padding = (kernel_size - 1) // 2 局限性:kernel_size只能是奇数 第二种方法: padding = (kernel_size * 2 + 1) // 2 解决了...

**各位同学上一节课我们介绍了信号上面的卷积运算,并且从信号上面的一个卷积运算类推到我们这里的二维图片上面一个卷积运算,也就是说,从一个核到一个整个图片之间,一个这两个函数之间的,做一个积分,然后形成的...

通过卷积层与池化层后,特征图的大小怎么计算 这里引入cs231n中的课件说明...参数:W:宽 H:高 D:深度 K:卷积核的个数 F:卷积核的大小 S:步长 P:用0填充 W/H=[(输入大小-卷积核大小+2*P)/步长] +1. 举...

注意非对称卷积只可以有一个卷积使用padding,不然与普通卷积输出的尺寸不一致。

推荐文章

- 阿里云企业邮箱的stmp服务器地址_阿里云stmp地址-程序员宅基地

- c++ 判断数学表达式有效性_高考数学大题如何"保分"?学霸教你六大绝招!...-程序员宅基地

- 处理office365登录出现服务器问题_o365登陆显示网络异常-程序员宅基地

- Nginx RTMP源码分析--ngx_rtmp_live_module源码分析之添加stream_ngx_rtmp_live_module 原理-程序员宅基地

- 基于Ansible+Python开发运维巡检工具_automation_inspector.tar.gz-程序员宅基地

- Linux Shell - if 语句和判断表达式_shell if elif-程序员宅基地

- python升序和降序排序_Python排序列表数组方法–通过示例解释升序和降序-程序员宅基地

- jenkins 构建前执行shell_Jenkins – 在构建之前执行脚本,然后让用户确认构建-程序员宅基地

- 如何完全卸载MySQL_mysql怎么卸载干净-程序员宅基地

- AndroidO Treble架构下HIDL服务查询过程_found dead hwbinder service-程序员宅基地